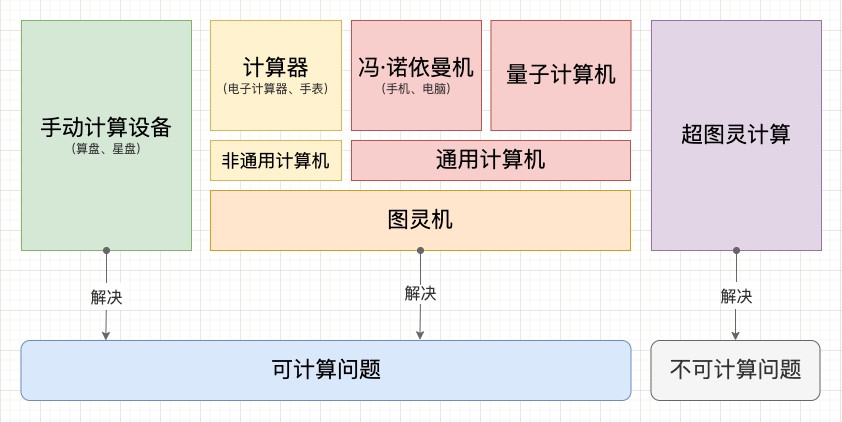

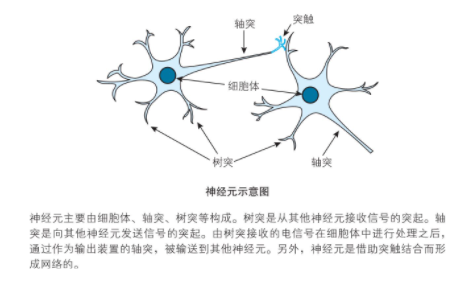

一麦卡洛克和皮茨发表那篇里程碑式论文的同一年,艾伦·图灵正在布莱切利公园破译德国恩尼格玛密码机。他和团队用智慧拯救了数十万的生命,对盟军在二战中的胜利起到了关键作用。 他们的交集同样与罗素有关。 在20世纪初,数学家和逻辑学家都在试图找到一种能够将所有的数学真理减少到一套简单的公理和逻辑规则的系统。 这就是著名的希尔伯特计划,由德国数学家大卫·希尔伯特提出。罗素及其合作者怀特海在《数学原理》一书中就做了这样的尝试,他们试图将数学基础建立在形式逻辑的基础之上。然而,希尔伯特计划在1931年遭到了挫败,因为哥德尔证明了他的不完备性定理。 这个定理表明:任何足够强大的形式系统,都存在一些在该系统内部既不能被证明也不能被反驳的命题。  1936年,图灵在一篇论文里研究了希尔伯特的“计算性”和“判定性问题”。 为了解决这个问题,图灵首先定义了“计算”这个概念,并创建了图灵机,这是一种理论上的计算设备。然后,他通过构造了一个图灵机无法解决的问题(即停机问题)来证明判定问题实际上是无法解决的。 这意味着没有一个通用的算法能对任何可能的问题都给出答案。 一个意外收获是:图灵创立了一个新的研究领域——计算理论(或可计算性)。图灵机给出了一个对“计算”或“算法”进行形式化的方式,这不仅在他的原始问题中有用,而且对整个计算机科学的发展产生了深远影响。 实际上,现代所有的电子计算机都是基于图灵机模型的,这使得图灵机成为了计算理论的核心。  没有证据表明麦卡洛克和皮茨看过图灵的论文。他们两个人的共同兴趣是,应用莱布尼茨机械大脑的设想来建立一个大脑思维模型。 《数学原理》中仅使用了与、或、非三种基本逻辑运算,就将一个个简单命题连接成越来越复杂的关系网络,进而描述清楚了整个数学体系。(尽管并不完备)  麦卡洛克则构想:人类的思考,是否也是靠神经元来执行这些最基础的逻辑运算而实现的? 皮茨在数学和逻辑上天赋,帮助麦卡洛克完成了这一伟大构想。  麦卡洛克和皮茨(左) 麦卡洛克和皮茨在1943年提出的神经元模型,构成了今天我们称之为人工神经网络的基础。 他们的模型描绘了一种简化的神经元,当其接受到的输入超过一定阈值时,就会被激活并向其它神经元发送信号。 这个模型的一个关键思想就是,即使每个单独的神经元都很简单,但是通过将它们联接在一起,就能形成一个能处理非常复杂问题的网络。 虽然单一的麦卡洛克-皮茨神经元只能完成简单的逻辑任务,但是,当将这些神经元组成一个复杂的网络时,神经网络就能进行复杂的计算,从而表现出图灵完备性。 事实上,神经网络是实现人工智能(AI)的重要方法之一。 通过设计不同的网络结构,并使用大量的数据对网络进行训练,人工神经网络可以学习到完成各种任务的能力,包括图像识别、语音识别、自然语言处理等等。 二 AI的神经网络,是对人类大脑和基于社会化网络的人类群体智慧的模仿游戏。人类大脑神经元结构和工作原理如下:  图片来自《深度学习的数学》一书。 以上原理,用计算模拟和解释,就是:神经元在信号之和超过阈值时点火,不超过阈值时不点火。 20世纪五六十年代,奥利弗·塞弗里奇创造了名为“鬼域”的概念。这是一个图案识别设备,其中进行特征检测的“恶魔”通过互相竞争,来争取代表图像中对象的权利。 “鬼域”是生动的关于深度学习的隐喻,如下图:  图片来自《深度学习》一书。 上图是对当前多层次深度学习网络的隐喻:

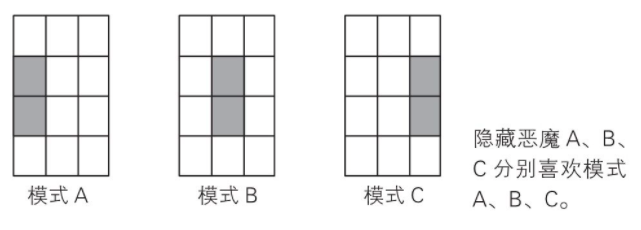

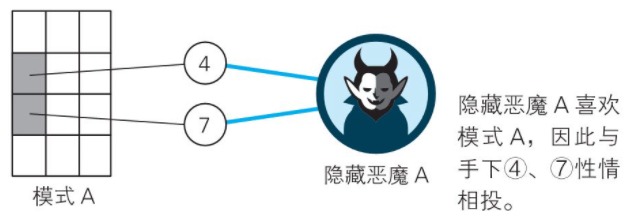

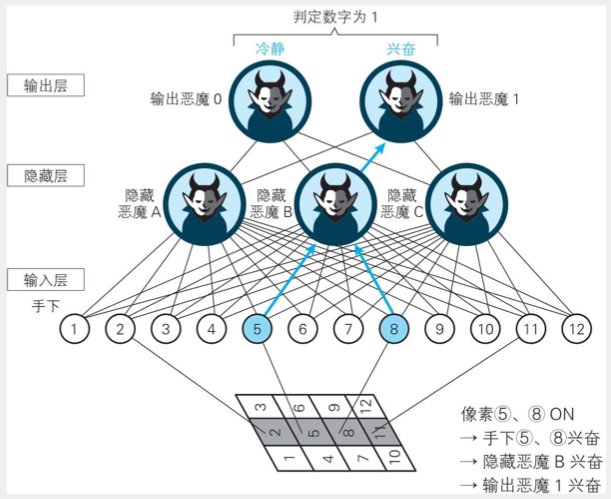

《深度学习的数学》一书中,依照如上隐喻,用一个生动的例子,讲解了神经网络的工作原理。 问题:建立一个神经网络,用来识别通过 4×3 像素的图像读取的手写数字 0 和 1。  第一步:输入层 12个格子,相当于每个格子住一个人,分别编号为1-12。如下图。  第二步:隐藏层 这一层,负责特征提取。假设有如下三种主要特征,分为为模式A、B、C。如下图。  不同的模式对应着相应的数字格子的组合。如下图。模式A对应的是数字4和7,B对应5和8,C对应6和9。  第三步:输出层 这一层,从隐藏层那里获得信息。  如上图,最下面是AI要识别的图像。 首先,输入层的2、5、8、11点火; 然后,隐藏层5和8所对应的特征被提取,“模式B”点火; 最后,输出层的1被对应的“模式B”点火。 所以,“大恶魔”识别出图像为数字1。 在上面的例子里,AI可以精确地识别出0和1,但它并不懂0和1,它的眼里只有像素。 可这么说,似乎过于拟人化了。人类又如何懂0和1呢? 人类不也是通过双眼输入,通过迄今仍是宇宙间最大谜团的大脑神经元网络(更加复杂、强大且节能的隐藏层)提取特征,然后通过大脑的某个部位再进行自我解释的吗? 辛顿曾在采访中提及,认知科学领域两个学派关于“大脑处理视觉图像”的不同理念: 一派认为,当大脑处理视觉图像时,你拥有的是一组正在移动的像素。如同上面的演示; 另一学派偏向于老派的人工智能,认为是分层、结构性的描述,脑内处理的是符号结构。 辛顿自己则认为以上两派都不对,“实际上大脑内部是多个神经活动的大向量。”而符号只是存在于外部世界。 不管怎样,神经网络的模型有用,并且非常有用。 不愿意和外行分享专业话题的辛顿,用如下这段话生动介绍了“神经网络”:

|

|手机版|小黑屋|博士驿站:连接全球智慧,共创博士人才生态圈

( 浙ICP备2023018861号-3 )平台提供新鲜、免费、开放、共享的科技前沿资讯、博士人才招聘信息和科技成果交流空间。

平台特别声明:线上内容(如有图片或视频亦包括在内)来自网络或会员发布,均已备注来源;本站资讯仅提供信息和存储服务。Notice: The content above (including the pictures and videos if any) is uploaded and posted by user , which is a social media platform and only provides information storage services.

|手机版|小黑屋|博士驿站:连接全球智慧,共创博士人才生态圈

( 浙ICP备2023018861号-3 )平台提供新鲜、免费、开放、共享的科技前沿资讯、博士人才招聘信息和科技成果交流空间。

平台特别声明:线上内容(如有图片或视频亦包括在内)来自网络或会员发布,均已备注来源;本站资讯仅提供信息和存储服务。Notice: The content above (including the pictures and videos if any) is uploaded and posted by user , which is a social media platform and only provides information storage services.

GMT+8, 2026-3-10 19:49

Powered by Discuz! X3.5

© 2001-2024 Discuz! Team.